Argomenti

Il 25 agosto 2023 è entrato in vigore il Digital Services Act: un pacchetto di norme (forse uno dei testi più importanti di questa legislatura europea) che si applicano a intermediari e fornitori di servizi della società dell’informazione: social network e piattaforme per la condivisione di contenuti, e-commerce e app store, provider e servizi di hosting e in cloud, piattaforme per la sharing economy, ecc.

Il Digital Services Act mira a introdurre «valori europei nel mercato digitale», come ha tenuto a sottolineare la presidente della Commissione Europea Ursula von der Leyen.

Sostanzialmente l’obiettivo principale è quello di promuovere ambienti online più sicuri.

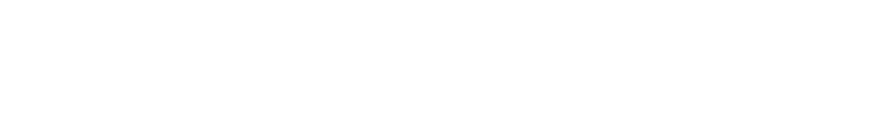

Insieme al Digital Markets Act, il Digital Services Act compone quel Digital Services Package che garantirà ai cittadini europei maggiore trasparenza e sicurezza online, maggiore moderazione dei contenuti e garanzia della privacy, controllo da parte dell’utente oltre che la lotta a contenuti dannosi per la libertà di espressione. Queste norme sono destinate a portali con oltre 45 milioni di utenti mensili attivi.

Ad oggi questi portali sono diciannove: X (ex Twitter), TikTok, Instagram, Wikipedia, Zalando, AliExpress, Amazon, Apple AppStore, Bing, Booking, Facebook, Google Ricerca, Google Play, Google Maps, Google Shopping, LinkedIn, Pinterest, Snapchat e YouTube. A febbraio le regole verranno estese anche alle piattaforme più piccole.

Le consultazioni pubbliche per un nuovo pacchetto di norme europee sui servizi digitali sono partite nel 2020 ma il testo definitivo del Digital Services Act (anche abbreviato in DSA) è stato approvato dal Parlamento europeo il 5 luglio 2022 anche se è stato necessario attendere oltre un anno perché le sue previsioni diventassero almeno in parte vincolanti.

CONTROLLO

Il Digital Services Act obbliga piattaforme e fornitori di servizi digitali a collaborare con le autorità nazionali, non solo nel caso in cui sia necessario segnalare reati e altre condotte illecite ma più “routinariamente”, anche attraverso l’operato di una nuova autorità indipendente preposta, il cosiddetto Digital Services Coordinator.

Più in generale, i fornitori di servizi digitali saranno obbligati a sottoporsi periodicamente ad audit da parte di soggetti terzi, siano essi soggetti istituzionali appunto o ricercatori e soggetti accademici.

Le aziende inoltre dovranno redigere rapporti annuali per verificare il rispetto dei requisiti e sia le autorità che i ricercatori esterni potranno avere accesso alla progettazione degli algoritmi che determinano la visualizzazione dei contenuti.

In caso di violazioni sono previste multe fino al 6% del fatturato globale con la possibilità di messa al bando in caso di recidiva.

LE PRINCIPALI NOVITÀ

Le principali novità introdotte dal DSA sono sostanzialmente tre:trasparenza di algoritmi e pubblicità, lotta alla violenza online e alla disinformazione, protezione dei minori.

- In punto trasparenza, il Digital Service Actimpone di fatto alle piattaforme di rispondere al grande questo: “Perché vedo questa cosa”?

La risposta è che adesso la “misura” dell’algoritmo deve essere leggibile, se non all’utente medio, almeno ai soggetti qualificati che operano nel settore.

L’utente più semplicemente potrà scegliere, se le condizioni d’uso lo prevedono, di visualizzare i contenuti pubblicati dai propri contatti in ordine cronologico e senza personalizzazione algoritmica, come già hanno annunciato di fare il Gruppo Meta e Tiktok.

Vale a dire che le piattaforme dovranno garantire agli iscritti la possibilità di disattivare la selezione algoritmica e cioè di visualizzare sui feed per primi i post e contenuti pubblicati più di recente, secondo un ordine cronologico e non automaticamente filtrati tenendo conto di interazioni più frequenti o preferenze espresse al momento dell’iscrizione al servizio.

Quanto alla pubblicità, le piattaforme dovranno garantire più trasparenza sia condividendo con gli utenti più informazioni riguardo al motivo per cui visualizzano certi annunci e sia dando loro la possibilità di bloccare in toto la profilazione a scopo commerciale.

N.B. Per limitare l’influenza della pubblicità online, questa non potrà usare le informazioni che riguardano dati sensibili come la religione, la salute, l’orientamento sessuale. Al contempo, non si potranno usare i dati dei minori per proporre loro pubblicità personalizzata.

Saranno infine vietati i dark pattern, ovvero quei metodi che servono a indirizzare in modo subdolo gli utenti verso scelte precise. Fino a qualche tempo fa erano la norma nei banner dei cookie, in cui il pulsante “accetta” era colorato, mentre gli altri erano grigi.

Sarà molto più complesso, per le piattaforme, discriminare tra attività che operano nello stesso settore di mercato in termini di richiesta di fondi per le sponsorizzazioni.

Trasparenza dell’algoritmo significa, per gli operatori economici e per i professionisti del settore, maggior libertà di concorrenza e maggior governabilità dei risultati in base alle premesse operative. In poche parole, i professionisti del settore avranno la possibilità di comprendere meglio perché un post pubblicitario ha successo o meno.

- Punto delicatissimo è la regolamentazione dei contenuti sulla base dell’incitamento all’odio, delle scene di violenza e del contrasto alla disinformazione.

Gli utenti dovranno poter segnalare più facilmente post e contenuti illeciti o che per diverse ragioni considerano controversi.

Anche a questo compito assolverà il Compliance Officer di cui le piattaforme più grandi sono obbligate a dotarsi dal nuovo Digital Services Act. Ci dovrà essere, in altre parole, un team dedicato alla moderazione in grado di stabilire codici di condotta chiari e specifici e di giudicare, a valle, ogni caso in maniera trasparente e imparziale.

N.B. Qualsiasi utente che vedrà segnalato o cancellato un post dovrà sapere esattamente perché ciò è avvenuto ed eventualmente come e a chi fare reclamo.

Non basterà più dire che si sono violati i termini e condizioni in modo generico ma dovranno essere informati sulle ragioni per cui un post è stato rimosso, o ne sia stata limitata la visibilità o la monetizzazione.

I termini e condizioni poi, dovranno essere esposti in modo più chiaro e semplice.

Analogamente al controllo dei contenuti social, i marketplace dovranno verificare che non sia venduta merce illegale nei loro negozi online.

COME SI STANNO ADEGUANDO LE AZIENDE

Buona parte delle aziende interessate ha già fatto sapere di aver preso i provvedimenti necessari per essere a norma.

- TikTok ha giocato di anticipo introducendo già a luglio delle norme e degli aggiornamenti che semplificano agli utenti la segnalazione di contenuti illegali.

- Meta (società madre di Facebook e Instagram) è già intervenuta sulla visualizzazione dei contenuti e sulla pubblicità, specie su Stories e Reels.

- Google ha ricordato che molte delle richieste del DSA sono in atto da tempo e che ha migliorato il suo Transparency center.

- X ha annunciato che in brevissimo tempo le nuove norme saranno recepite e attuate.

Le uniche critiche arrivano da Zalando e Amazon che hanno annunciato ricorso per essere stati inseriti in questo speciale elenco pur non presentando un rischio sistemico e quindi da non considerarsi una VLOP.

COSA CAMBIA PER GLI UTENTI

Riportiamo in conclusione l’editoriale di agendadigitale.eu.

“Editore o edicola? Questa la domanda che ci si poneva, anni fa, sula natura dei social network.

Ora è chiaro che si tratta di soggetti privati il cui mercato è regolamentato in modo più stringente e che, nelle ipotesi in cui operano in settori sensibili, ossia la manifestazione del pensiero, le posizioni politiche e l’informazione, sono sostanzialmente equiparati ai media tradizionali.

Operano, di fatto, come un vero e proprio servizio pubblico e sono soggetti alle scelte e alla determinazione dei pubblici poteri nei contesti di crisi.

Il business model cambia moltissimo rispetto alle origini, ma le dimensioni e l’impatto avuto negli anni da questi soggetti stato letteralmente smisurato.

All’alba dell’acquisizione di Twitter da parte di Elon Musk, alcuni osservatori – attenti – del mercato dei social deridevano l’imprenditore visionario per l’imprudenza della scelta, perché affermare pubblicamente che non ci sarebbe più stata moderazione dei contenuti su Twitter equivaleva a rinunciare al business del social stesso, ossia la selezione dei contenuti.

Per quanto le interferenze del partito democratico statunitense nel contesto di Twitter siano state acclarate da controlli interni post acquisizione, va comunque osservato che quello era, a tutti gli effetti, il business di Twitter.

La scelta di attribuire rilevanza ai fact checker indipendenti, poi, lascia il tempo che trova.

O sono soggetti privati, con ideologia di riferimento e relativi committenti, o sono soggetti pubblici e, come tali, necessariamente di tendenza, almeno in parte.

In conclusione, la ricerca dell’equilibrio è complessa, perché gli estremi tra cui ci si muove sono – e restano, forse, per sempre – il selvaggio West senza regole a cui il web ci ha abituati fino ad ora e come accade quotidianamente ancora oggi in Russia e Cina.